By : Zhang Taehun

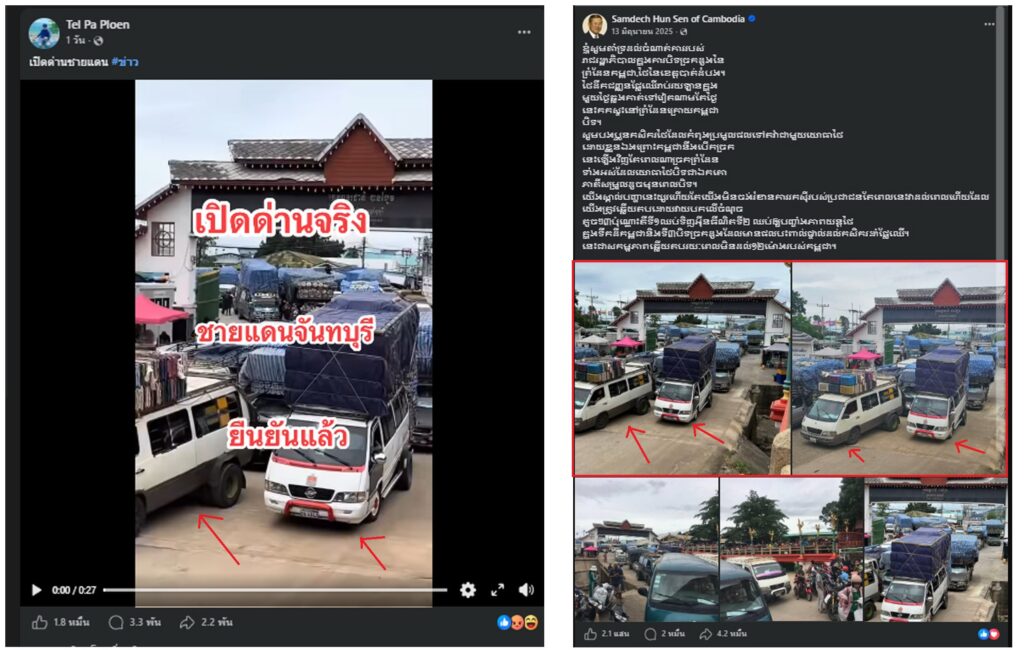

ย้อนไปเมื่อเดือนมีนาคม 2569 มีข่าวหนึ่งที่สังคมให้ความสนใจ กรณีกลุ่มคนรวมตัวกันไปทำร้ายร่างกายชายหนุ่มเชื้อสายกะเหรี่ยง โดยอ้างว่าชายคนดังกล่าวเป็นบุคคลต่างด้าวและมีพฤติกรรมหาเรื่องคนไทย อย่างไรก็ตาม ฝ่ายผู้ถูกทำร้ายที่เข้าแจ้งความได้ยืนยันว่าตนเองเป็นชาวกะเหรี่ยงที่เกิดและเติบโตใน จ.กาญจนบุรี เช่นเดียวกับผู้ใหญ่บ้าน หมู่บ้านห้วยน้ำขาว หมู่ 15 ตำบลบ้านเก่า อ.เมือง จ.กาญจนบุรี ก็ยืนยันว่า หนุ่มชาวกะเหรี่ยงรายนี้เกิดและเติบโตในประเทศไทย มีพยานรับรองและอยู่ระหว่างดำเนินการขอมีบัตรประชาชนไทย

ในด้านของคดีความก็เป็นเรื่องหนึ่ง แต่ที่ผู้เขียนหยิบยกเรื่องนี้มากล่าวถึงก็เพราะหลังจากได้เข้าไปไล่อ่านความคิดเห็นของประชาชนที่ติดตามข่าวดังกล่าว พบว่าบางส่วนยังมีความเข้าใจคลาดเคลื่อนเกี่ยวกับบัตรประจำตัวของผู้ที่ไม่มีสัญชาติไทย มีข้อสงสัยว่าชาวกะเหรี่ยงมาขอมีบัตรประชาชนไทยได้อย่างไร รวมถึงเหมารวมกันไปว่าชาวกะเหรี่ยงทั้งหมดเป็นต่างด้าวไม่ใช่คนไทย ซึ่งสอดคล้องกับภารกิจของภาคีโคแฟค (ประเทศไทย) ในการตรวจสอบและอธิบายข้อเท็จจริง (Fact – Checking) ของข้อมูลข่าวสารที่ถูกแชร์กันบนพื้นที่ออนไลน์ด้วย

ภาพที่ 1 ศูนย์การเรียนชุมชนศรีสุวรรณสะเนพ่อง (วิถีกะเหรี่ยงทุ่งใหญ่นเรศวร) ต.ไล่โว่ อ.สังขละบุรี จ.กาญจนบุรี ที่มา : แนวหน้า – ชาวกะเหรี่ยงเป็นใครมาจากไหน? เข้ามาอยู่ในอาณาเขตประเทศ ไทย เมื่อใด? : มีข้อเขียนและผลการศึกษามากมายที่กล่าวถึงกลุ่มชาติพันธุ์กะเหรี่ยง ซึ่งอาศัยอยู่ในบริเวณที่ปัจจุบันเป็นพื้นที่เมืองหรือจังหวัดชายแดนไทย – เมียนมา มาหลายร้อยปี อาทิ บทความ “ กะเหรี่ยง ความสัมพันธ์อันยาวนานกับไทย ” โดย สุรพงษ์ กองจันทึก ที่เผยแพร่ในนิตยสารศิลปวัฒนธรรม เล่าถึงชาวกะเหรี่ยงในเมืองศรีสวัสดิ์ (ปัจจุบันคือ อ.ศรีสวัสดิ์ จ.กาญจนบุรี) มีบันทึกว่าได้จ่ายส่วย (ภาษี) และเข้าเป็นทหารทำหน้าที่รายงานความเคลื่อนไหวของพม่าให้กับกรุงศรีอยุธยา

เมื่อล่วงเข้าสู่สมัยกรุงรัตนโกสินทร์ ในสมัยรัชกาลที่ 1 มีชาวกะเหรี่ยงอพยพเข้ามาในเมืองกาญจนบุรี และได้รับอนุญาตให้ไปตั้งรกรากที่เมืองสังขละบุรี (ปัจจุบันคือ อ.สังขละบุรี จ.กาญจนบุรี) หลังจากนี้ชาวกะเหรี่ยงยังคงยอมรับการปกครองและเข้าเป็นทหารของฝ่ายไทย จนกระทั่งเมื่อเข้าสู่สมัยรัชกาลที่ 5 มีการปรับปรุงการปกครองให้เป็นแบบรัฐสมัยใหม่ ชาวกะแหรี่ยงถูกกำหนดสิทธิและหน้าที่ต่อรัฐไม่ต่างจากคนไทย อาทิ ต้องเสียภาษีเข้ารัฐส่วนกลาง ต้องเข้ารับราชการทหารในรูปแบบกองทัพส่วนกลางมิใช่ในระบบไพร่สังกัดมูลนายแบบเดิม

รวมถึงเมื่อมีการตั้งกองตำรวจภูธร สมเด็จฯ กรมพระยาดำรงราชานุภาพ ก็รับสั่งว่า ชาวกะเหรี่ยงที่เคยรับราชการในสังกัดกองอาทมาต (ทหารหน่วยพิเศษในระบบกองทัพแบบเดิมก่อนหน้าการปฏิรูป) สามารถเข้ารับราชการต่อในสังกัดหน่วยงานใหม่นี้ได้ อย่างไรก็ตาม ในสายตาของคนไทยโดยเฉพาะเจ้าหน้าที่รัฐ มักมองชาวกะเหรี่ยงในแง่ลบอยู่เสมอ โดยเฉพาะวิถีชีวิตด้านเกษตรกรรมของชาวกะเหรี่ยงถูกมองว่าเป็นการบุกรุกทำลายป่า ขณะที่ชาวกะเหรี่ยงตลอดจนผู้สนใจศึกษาวิถีชีวิตของชาวกะเหรี่ยง โต้แย้งว่าวิถีดังกล่าวคือ “ไร่หมุนเวียน” นอกจากจะไม่ทำลายป่าแล้วยังช่วยอนุรักษ์ธรรมชาติเสียด้วยซ้ำไป

ข้อมูลจากศูนย์มานุษยวิทยาสิรินธร (องค์การมหาชน) ระบุว่า การเข้ามาอยู่อาศัยของชาวกะเหรี่ยงบนแผ่นดินที่ปัจจุบันคือประเทศไทย มีตั้งแต่การถูกกวาดต้อนมาเป็นเชลย การอพยพหนีการกวาดล้างของอาณาจักรพม่าที่รบชนะอาณาจักรมอญซึ่งชาวกะเหรี่ยงที่อยู่ร่วมกับชาวมอญก็ต้องหลบหนีออกมาด้วย จนถึงยุคหลังอาณานิคมที่ดินแดนพม่าก็ยังมีปัญหาความไม่สงบทางการเมือง ทำให้ชาวกะเหรี่ยงเลือกที่จะอพยพข้ามชายแดนมายังฝั่งไทย

โดยปัจจุบันมีชุมชนชาวกะเหรี่ยงในประเทศไทยถึง 15 จังหวัด คือ เชียงราย แม่ฮ่องสอน เชียงใหม่ ลำพูน ลำปาง แพร่ ตาก สุโขทัย กำแพงเพชร อุทัยธานี สุพรรณบุรี กาญจนบุรี ราชบุรี เพชรบุรี และประจวบคีรีขันธ์ อนึ่ง นอกจากชาวกะเหรี่ยงแล้ว ฐานข้อมูลของศูนย์มานุษยวิทยาสิรินธร (องค์การมหาชน) ยังระบุว่า ในประเทศไทยมีกลุ่มชาติพันธุ์ต่าง ๆ รวมกันมากถึง 60 กลุ่ม

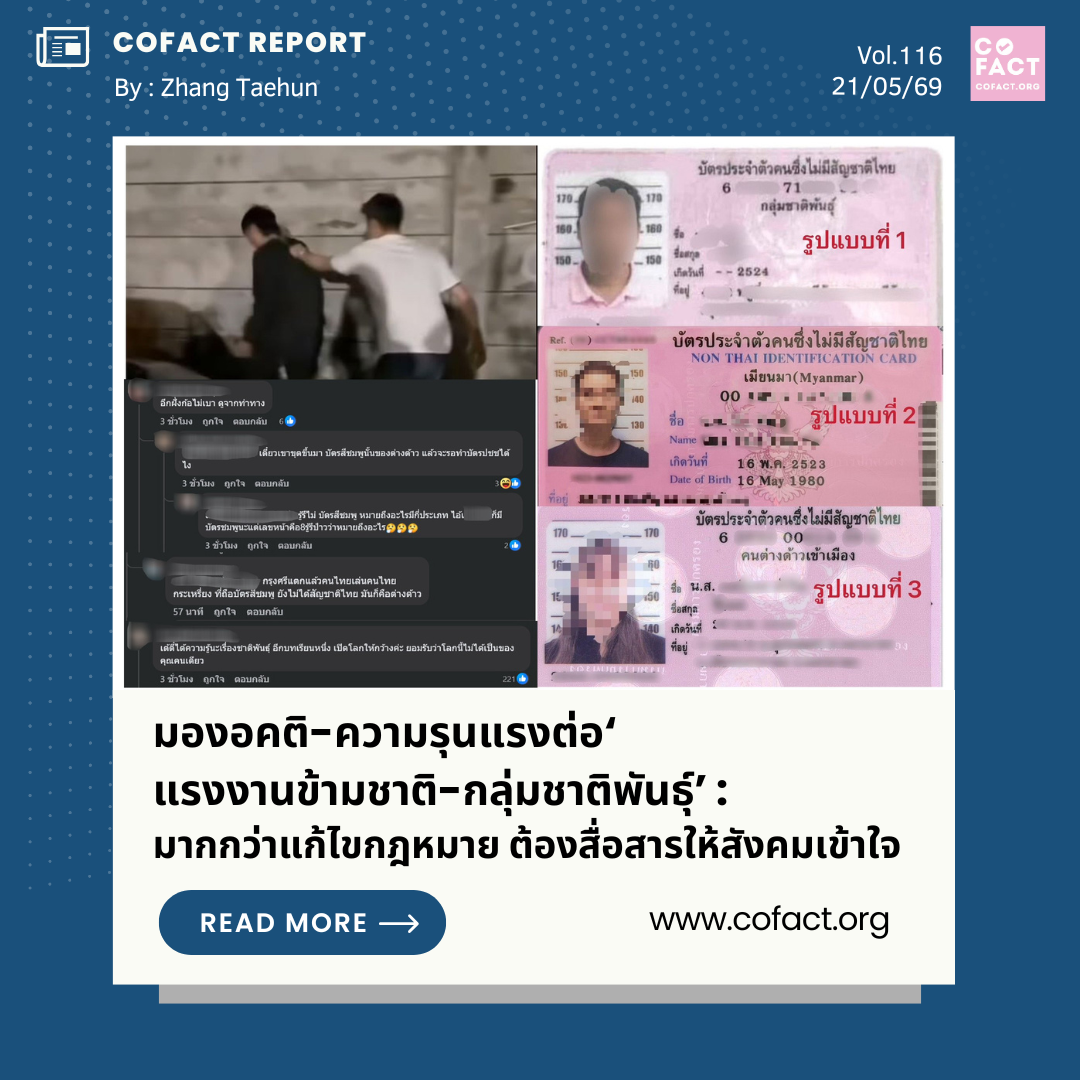

ภาพที่ 2 ตัวอย่างบัตรประจำตัวและเลขประจำตัวบุคคลที่อยู่อาศัยในประเทศไทย ทั้งที่เป็นคนไทยและบุคคลที่ไม่มี สัญชาติไทย

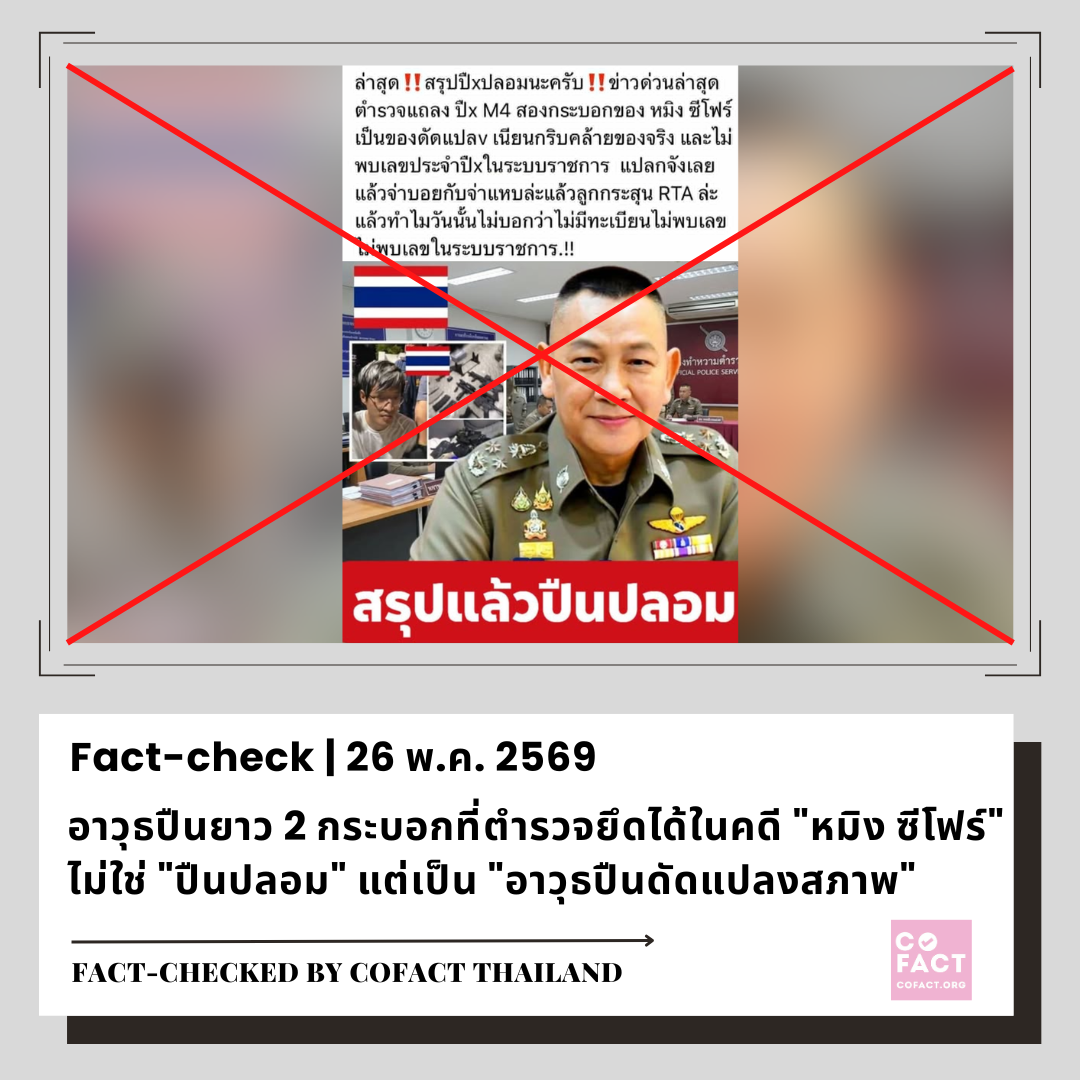

(3 ภาพด้านซ้าย ขอบคุณภาพจากเพจ “คลินิกกฎหมาย มูลนิธิกระจกเงา”) – กลุ่มชาต ิพันธุ์บนแผ่นดินไทยกับสถานะทางกฎ หมาย : บุคคลที่อยู่อาศัยในประเทศไทยเป็นเวลานาน ไม่ว่าจะเป็นผู้มีหรือไม่มีสัญชาติไทยก็ตาม หากเข้าสู่ระบบฐานข้อมูลของทางการไทย จะได้รับเลขประจำตัว หรือที่คุ้นเคยในชื่อ “ เลข 13 หลัก ” โดยข้อมูลจากที่ทำการปกครองจังหวัดขอนแก่น ซึ่งเป็นหน่วยงานสังกัดกรมการปกครอง กระทรวงมหาดไทย อธิบาย “ ตัวเลขหลักที่ 1 หรือเลขตัวแรก ” บนบัตรประจำตัวบุคคล (ทั้งในบัตรประชาชนของคนไทย และบัตรประจำตัวคนซึ่งไม่มีสัญชาติไทย) ไว้ดังนี้

“ เลข 1 ” หมายถึงคนที่เกิดและมีสัญชาติไทย ได้แจ้งเกิดภายในกำหนดเวลา นับตั้งแต่วันที่ 1 ม.ค.2527 เป็นต้นมา , “ เลข 2 ” หมายถึงคนที่เกิดและมีสัญชาติไทย แต่แจ้งเกิดเกินเวลาที่กำหนด ซึ่งนับตั้งแต่วันที่ 1 ม.ค. 2527 เป็นต้นมา , “ เลข 3 ” หมายถึงคนไทยและคนต่างด้าวที่มีใบสำคัญประจำตัวคนต่างด้าวและมีที่อยู่ในทะเบียนบ้านในสมัยเริ่มแรก (1 ม.ค. – 31 พ.ค.2527) , “ เลข 4 ” หมายถึงคนไทยและคนต่างด้าวที่มีใบสำคัญคนต่างด้าวแต่แจ้งย้ายเข้า โดยยังไม่มีเลขประจำตัวประชาชนในสมัยเริ่มแรก (1 ม.ค. – 31 พ.ค. 2527) ,

“ เลข 5 ” หมายถึงคนไทยที่ได้รับอนุมัติให้เพิ่มชื่อเข้าในทะเบียนบ้านในกรณีตกสำรวจหรือกรณีอื่น ๆ, “ เลข 6 ” หมายถึงผู้ที่เข้าเมืองโดยไม่ชอบด้วยกฎหมาย และผู้ที่เข้าเมืองโดยชอบด้วยกฎหมาย แต่จะอยู่ในลักษณะชั่วคราว , “ เลข 7 ” หมายถึงบุตรของบุคคลประเภทที่ 6 (ผู้ถือบัตรเลข 6) ซึ่งเกิดในประเทศไทย และ “ เลข 8 ” หมายถึงคนต่างด้าวที่เข้าเมืองโดยถูกต้องตามกฎหมาย คือได้รับใบสำคัญประจำตัวคนต่างด้าว – คนที่ได้รับการแปลงสัญชาติเป็นสัญชาติไทย และคนที่ได้รับการให้สัญชาติไทย

นอกจากเลข 1 – 8 ข้างต้นแล้ว ในคู่มือการจัดทำทะเบียนและบัตรประจำตัวบุคคลผู้ไม่มีสัญชาติไทยโดยสำนักบริหารการทะเบียน กรมการปกครอง กระทรวงมหาดไทย ยังกล่าวถึงเลขตัวแรกของบัตรประจำตัวคนซึ่งไม่มีสัญชาติไทย ไว้อีก 2 กลุ่ม คือ “ เลข 0 ”

และ “ เลข 00 ” แรงงานต่างด้าวหลบหนีเข้าเมือง โดยเป็นบุคคลสัญชาติพม่า (เมียนมา) ลาวและกัมพูชา ที่ได้รับการจัดทำทะเบียนประวัติและได้รับอนุญาตให้ทำงานตามมติ ครม. รวมถึงผู้ติดตามแรงงาน ส่วนที่มาของการกำหนดปี 2527 ไว้ในการออกเลขตัวแรกของชุดเลขประจำตัวบุคคล 13 หลัก เนื่องด้วยเป็นปีแรกที่ประเทศไทยจัดทำฐานข้อมูลเลขประจำตัว 13 หลักในระบบคอมพิวเตอร์แทนระบบเขียนด้วยมือแบบเดิม

บัณฑิต นามเครือ ผู้อำนวยการส่วนสัญชาติและการทะเบียนและบัตรประจำตัวบุคคลผู้ไม่มีสัญชาติไทย สำนักบริหารการทะเบียน กรมการปกครอง อธิบายว่า ระบบเลขประจำตัว 13 หลักของไทย กำหนดโดยสำนักทะเบียนกลาง กรมการปกครอง กระทรวงมหาดไทย ถูกออกแบบให้แสดงสถานะทางทะเบียนราษฎรของบุคคล โดยกรณีเลขตัวแรกเป็นเลข 6 จะหมายถึงบุคคล 2 กลุ่ม คือ

1. กลุ่มชาติพันธุ์ คือ กลุ่มที่แสดงว่าบุคคลนั้นได้ผ่านกระบวนการสำรวจและจัดทำทะเบียนประวัติ ได้แก่ บุคคลที่เข้าเมืองโดยไม่ชอบด้วยกฎหมายหรือผู้ที่เข้าเมืองโดยชอบด้วยกฎหมายแต่ได้รับการยกเว้นให้อยู่ในลักษณะชั่วคราว เช่น ชนกลุ่มน้อยหรือกลุ่มชาติพันธุ์ซึ่งยังไม่มีสัญชาติไทย และมีกลุ่มชาติพันธุ์บางส่วนที่เกิดในประเทศไทยตั้งแต่บรรพบุรุษแต่ยังไม่สามารถที่จะพิสูจน์การเกิดเพื่อลงรายการสัญชาติไทยได้ ซึ่งปัจจุบันไม่มีการทำทะเบียนเลข 6 เพิ่มแล้ว มีเพียงคนที่ได้เลขประจำตัวแล้วบัตรประจำตัวหมดอายุหรือสูญหายก็จะมาทำบัตรใหม่โดยใช้เลขเดิม

“ อย่างไรก็ตาม ยังมีกลุ่มชาติพันธุ์ที่ตกหล่นจากการสำรวจ จึงได้รับการสำรวจและจัดทำทะเบียนในภายหลัง โดย สำรวจเพิ่มเติมเมื่อปี 2548 – 2554 กลุ่มเหล่านี้จะได้รับเลข 0 กลุ่ม 89 หมายถึงบุคคลที่ไม่มีสถานะทางทะเบียนตามยุทธศาสตร์การจัดการปัญหา และสถานะสิทธิของบุคคล ซึ่งมีความเกี่ยวพันธุ์กับชนกลุ่มน้อยเดิมที่ได้รับการสำรวจเป็นเลข 6”

กับ 2. คนต่างด้าวเข้าเมือง คือ บุคคลต่างด้าวที่เข้ามาอยู่ในประเทศไทยโดยถูกต้องตามกฎหมายคนเข้าเมืองแบบชั่วคราวตามระยะเวลาที่ได้รับ อธิบายให้เห็นภาพง่าย ๆ ให้นึกถึงเวลาไปเที่ยวต่างประเทศเราก็จะไปเที่ยวได้ตามระยะเวลาวีซ่าที่กำหนดให้อยู่ได้ ซึ่งหากอยู่เกินกำหนดก็จะถูกจับ ดังนั้น หากบุคคลต่างด้าวเข้ามาอยู่แบบชั่วคราวโดยถูกต้องก็สามารถมาขอทำทะเบียนบ้าน บัตรประจำตัวเป็นบุคคลเลข 6 ได้ตลอดเวลา แต่สิทธิการอยู่อาศัยต่าง ๆ ยังเป็นไปตามระยะเวลาหนังสือเดินทางวีซ่า เป็นต้น ส่วนเลข 7 ให้สำหรับบุคคลที่เกิดในประเทศไทย โดยมีบิดามารดาที่ถือบัตรเลข 6

ส่วนคำถามที่ว่าเหตุใดประชากรกลุ่มชาติพันธุ์ผู้ถือบัตรเลข 6 และ 7 ที่ดำเนินการยื่นขอสัญชาติไทย ขั้นตอนต่างๆ จึงยุ่งยากและล่าช้ามาก บางคนยื่นเรื่องตั้งแต่ยังเป็นหนุ่ม – สาว กว่าจะได้ก็แก่ชราอายุมาก ประเด็นนี้ บัณฑิต อธิบายว่า ความยาก – ง่ายต่างกันอยู่ที่ว่าเป็นการขอสัญชาติกรณีแบบใด ซึ่งหลักการขอสัญชาติไทยที่ง่ายที่สุด คือ การขอสัญชาติไทยเพราะเกิดในประเทศไทยและมีบิดามารดาเป็นกลุ่มชาติพันธุ์ ด้วยเหตุที่ว่าบุคคลเหล่านี้เกิดและอยู่ในประเทศไทยนานแล้ว

โดยหากดูตามมติ ครม. เมื่อวันที่ 29 ต.ค. 2567 จะให้สามารถดำเนินการให้แล้วเสร็จภายใน 5 วัน แต่ในทางปฏิบัติอาจมีระยะเวลาที่ต้องรอคิวในการยื่นขอสัญชาติ , เพิ่มชื่อเข้าในทะเบียนบ้าน , ทำบัตรประจำตัวประชาชน ระยะหนึ่งซึ่งปกติก็จะไม่เกิน 60 วัน ในกรณีเด็กเล็กที่เกิดในประเทศไทยและมีใบเกิดนั้นก็สามารถดำเนินการได้เร็วเพราะมีหลักฐานครบถ้วนซึ่งหลักฐานที่สำคัญที่สุดคือสูติบัตร

“ เด็กเล็กๆ มักจะแจ้งการเกิดมาหมดแล้วจึงรวดเร็วในการขอสัญชาติไทย ในส่วนเด็กที่โตขึ้นมาก็จะใช้เวลาในการดำเนินการ โดยเฉพาะในการขอหนังสือรับรองการเกิด เพราะกลุ่มเหล่านี้ไม่ได้มีการแจ้งการเกิดไว้ และส่วนใหญ่มักจะระบุว่าเกิดจากหมอตำแย ซึ่งต้องพิสูจน์ตามระเบียบเพื่อป้องกันไม่ให้เกิดการทุจริต ”

ในส่วนบุคคลที่พิสูจน์การเกิดในประเทศไทยไม่ได้ หรือผู้ที่อายุเยอะซึ่งไม่ได้เกิดในประเทศไทย ก็จะต้องขอสัญชาติไทยในกรณีอื่นๆ ซึ่งมักจะเรียกว่าขอสัญชาติไทยโดยการแปลงสัญชาติ กรณีนี้จะใช้ระยะเวลานานถึง 3 ปี ขึ้นไป ในการรวบรวมหลักฐาน และขอสัญชาติไทย เพราะมีเงื่อนไขว่าจะต้องมีหลักฐานการทำงานและเสียภาษีในประเทศไทย 3 ปี หากไม่มีก็จะไม่สามารถขอได้ เป็นต้น เพื่อให้คนที่จะเป็นคนไทยนั้นได้รับการคัดเลือกมาจากบุคคลที่มีศักยภาพตามความเหมาะสม ไม่เกิดภาระแก่รัฐไทย

ส่วนเลขประจำตัวที่ขึ้นต้นด้วยเลข 00 นั้น บัณฑิตอธิบายว่า หมายถึงคนต่างด้าวสัญชาติกัมพูชา ลาว เวียดนาม และเมียนมา รวมถึงคนต่างด้าวสัญชาติอื่นตามที่ผู้อำนวยการทะเบียนกลางประกาศกำหนด ซึ่งเป็นผู้ที่ผ่านการตรวจพิสูจน์สัญชาติและได้รับอนุญาตให้เข้ามาอยู่ ในราชอาณาจักรเป็นการชั่วคราวตามกฎหมายว่าด้วยคนเข้าเมืองและได้รับอนุญาตให้ทำงานตามกฎหมายหรือเป็นผู้ที่เข้ามาอยู่ในราชอาณาจักรโดยไม่ได้รับอนุญาตตามกฎหมายว่าด้วยคนเข้าเมืองและได้รับการผ่อนผัน ให้อาศัยอยู่ในราชอาณาจักรเป็นการชั่วคราวเพื่อทำงานตามกฎหมาย

‘ ดังนั้นแล้ว แรงงานต่างด้าวที่เข้ามาโดยถูกกฎหมายผ่านบันทึกความตกลง MOU ระหว่างประเทศไทยกับเมียนมา ลาว และกัมพูชา จะได้รับหมายเลขประจำตัว 13 หลัก อย่างไรก็ตาม เลขขึ้นต้น 00 ไม่ได้จำกัดแค่แรงงานต่างด้าวเท่านั้น แต่รวมถึงบุตรของบุคคลต่างด้าวด้วย ’

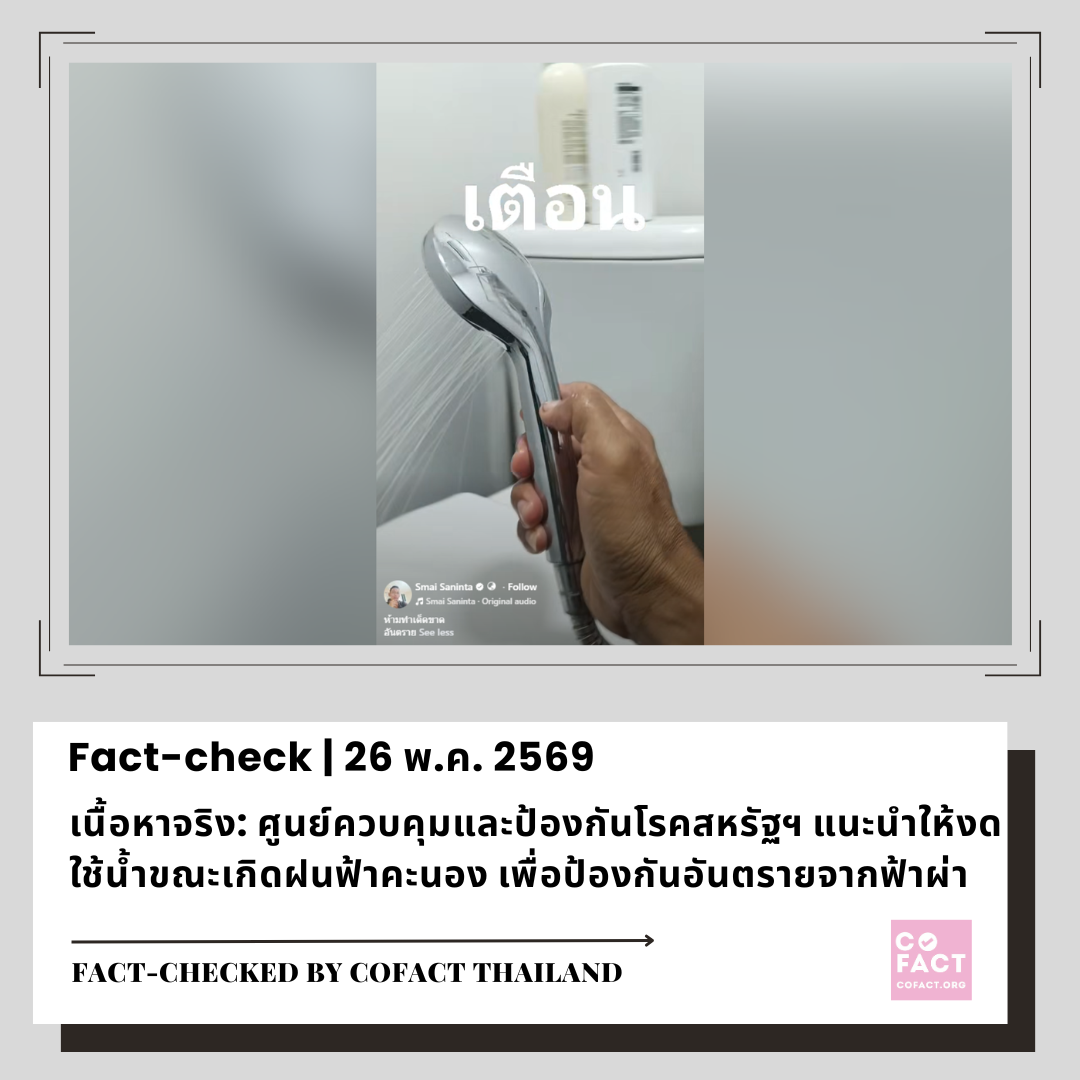

ภาพที่ 3 : ‘ เฮียตี๋ สเต็กกระทะร้อน ’ ( เสื้อขาวคนกลาง) ผู้ก่อเหตุร่วมกันทำร้าย ร่างกาย คู่กรณีที่เป็นกลุ่มชาติพันธุ์กะเหรี่ยง กล่าวขอโทษผ่านรายการ ‘ โหนกระแส ’ เมื่อวันที่ 11 มี.ค. 256 9 ยอมรับตนเองไม่มี ความรู้เรื่องก ลุ่มชาติพันธุ์ ที่ ใช้ชีวิตอยู่ในประเทศไทย

ชมคลิปได้ที่ : https://www.youtube.com/watch?v=60keb0mT1DM (นาทีที่ 31.50 – 32.20) – นอกจาก กฎหมาย แล้วยังต้อง สร้างความรู้ความเข้าใจ กับสังคมไทย : นอกจากประเด็นทางกฎหมายเรื่องสถานะบุคคลแล้ว อีกเรื่องหนึ่งที่สำคัญไม่ยิ่งหย่อนไปกว่ากันคือ ‘ การสร้างความรู้ความเข้าใจกับสังคมไทยเรื่องการอยู่ร่วมกันของกลุ่มชาติพันธุ์ที่หลากหลาย ’ ดังที่ผู้ร่วมก่อเหตุทำร้ายร่างกายหนุ่มกะเหรี่ยงกล่าวกับสื่อ ยอมรับว่าตนเองไม่มีความรู้เรื่องกลุ่มชาติพันธุ์และเข้าใจว่าเป็นบุคคลต่างด้าว รวมถึงหลายคนที่เข้าไปแสดงความคิดเห็นในสื่อสังคมออนไลน์ในช่วงที่เหตุการณ์เกิดขึ้นใหม่ ๆ ก็มีความเข้าใจในลักษณะเดียวกัน

ปรีดา คงแป้น กรรมการสิทธิมนุษยชนแห่งชาติ (กสม.) ให้ข้อมูลกับทีมงานโคแฟคเมื่อวันที่ 19 พ.ค. 2569 ว่า นับตั้งแต่ตนเข้ามารับตำแหน่ง กสม. ช่วงปี 2564 – 2569 ได้รับเรื่องร้องเรียนที่เกี่ยวข้องกับกลุ่มชาติพันธุ์ประมาณ 20 เรื่อง อันดับ 1 เป็นเรื่องปัญหาสถานะบุคคลหรือสถานะทางทะเบียน รองลงมาเป็นข้อพิพาทเรื่องที่อยู่อาศัยหรือที่ทำกิน เช่น ระหว่างชุมชนกับพื้นที่ป่า นอกจากนั้นยังมีเรื่องการเข้าไม่ถึงสิทธิขั้นพื้นฐาน เรื่องที่เกี่ยวข้องกับสิทธิเด็ก รวมถึงเรื่องการถูกด้อยค่า อาทิ กรณีหนุ่มชาวกะเหรี่ยงถูกทำร้ายตามที่ปรากฏเป็นข่าว

ซึ่งก่อนที่ตนจะมาเป็น กสม. เคยทำงานที่มูลนิธิชุมชนไทมาก่อน โดยเข้าไปทำงานกับกลุ่มชาวเลที่ถูกเบียดขับหลังเหตุการณ์คลื่นยักษ์สึนามิถล่มภาคใต้ฝั่งอันดามันเมื่อปี 2547 แล้วพบว่าชาวเลเป็นเหมือนกับพลเมืองชั้น 2 ในหมู่ประชากรที่อาศัยในพื้นที่ชายฝั่งอันดามันทั้งที่อยู่มาก่อนคนกลุ่มอื่นๆ สอดคล้องกับที่ รศ.ดร.นฤมล อรุโณทัย นักวิชาการสถาบันวิจัยสังคม จุฬาลงกรณ์มหาวิทยาลัย เคยกล่าวว่า ‘ สังคมไทยยังมีอคติกับ กลุ่มคนชายขอบ ’ โดยข้อค้นพบของตนจากกรณีชาวเล คือคนกลุ่มนี้ถูกเบียดขับอย่างรุนแรงเพราะอยู่ในพื้นที่แหล่งท่องเที่ยวระดับโลก

เช่นเดียวกับช่วงลงพื้นที่สำรวจปัญหาของชาวเล ดร.ม.ร.ว.อคิน รพีพัฒน์ ผู้เชี่ยวชาญด้านสังคมวิทยาและมานุษยวิทยา ซึ่งร่วมลงพื้นที่ด้วย ได้กล่าวว่า ‘ กลุ่มชาติพันธุ์ชาวเลถูกกระทำไม่ให้เขาภูมิใจหรือมั่นใจในวิถีชีวิต และวัฒนธรรมของเขา ’ และเมื่อมองมายังยุคปัจจุบันที่การสื่อสารทำได้กว้างขวางและรวดเร็วขึ้นผ่านสื่อสังคมออนไลน์ (Social Media) กรณีการไปคุกคามหนุ่มกะเหรี่ยงด้วยความเข้าใจว่าเป็นแรงงานข้ามชาติ ก็เป็นภาพสะท้อน ‘ รากทางความคิดของคนไทยที่ยังมองคนต่างด้าวเป็นอื่น ’ ไม่ใช่คนที่มาช่วยเหลืออะไรให้ประเทศไทย

จากการแก้ปัญหาชาวเล นำมาสู่มติคณะรัฐมนตรี (ครม.) ว่าด้วยการฟื้นฟูวิถีชีวิตชาวเล วันที่ 2 มิ.ย. 2553 และมติ ครม. ว่าด้วยแนวนโยบายในการฟื้นฟูวิถีชีวิตชาวกะเหรี่ยง วันที่ 3 ส.ค. 2553 จนกระทั่งปัจจุบันมีกฎหมาย พ.ร.บ.คุ้มครองและส่งเสริมวิถีชีวิตกลุ่มชาติพันธุ์ พ.ศ.2568 ทั้งหมดนี้คือความพยายามทำให้ประเทศไทยยอมรับว่ามีกลุ่มชาติพันธุ์อยู่ แต่ตลอดเส้นทางก็มักจะพบกระแสต่อต้าน หรือ ‘ทัวร์ลง’ ในพื้นที่ออนไลน์อยู่เสมอ ว่าบุคคลหรือองค์กรที่สนับสนุนแนวทางนี้ห่วงใยคนต่างด้าวมากกว่าคนไทย

นอกจากนั้น กสม. อยู่ระหว่างศึกษาเพื่อทำข้อเสนอแนะให้ปรับปรุงระเบียบหรือกฎหมายต่างๆ ให้สอดคล้องกับหลักสิทธิมนุษยชน อย่างไรก็ตาม ลำพังการแก้ไขกฎหมายยังไม่เพียงพอหากไม่ทำความเข้าใจกับสังคมควบคู่กันไปด้วย ซึ่งก่อนหน้านี้ตนเคยสนอให้สำนักงานกองทุนสนับสนุนการสร้างเสริมสุขภาพ (สสส.) และอีกหลายหน่วยงาน ช่วยกันคิดว่าจะสื่อสารเชิงบวกอย่างไรเพื่อให้สังคมไทยเข้าใจกลุ่มประชากรเหล่านี้ แต่ก็มีความท้าทายจากจำนวนสื่อที่มากขึ้นและอยู่นอกเหนือการควบคุม รวมถึงบรรดาผู้มีอิทธิพลทางความคิด (อินฟลูเอนเซอร์) ด้วย

‘ หน่วยงานที่กำกับต้องแข็งแรงและต้องกำกับเรื่องนี้อย่างจริงจังด้วย คือ กสม. ก็มีหน้าที่จี้ไปที่หน่วยงานต่าง ๆ รวมทั้งเรื่องที่จะสื่อสารให้คนในสังคมได้เข้าใจด้วย คือคนในสังคมโดยรวมอาจไม่เข้าใจว่าการที่เรามีแรงงานเพื่อนบ้านจะช่วยขับเคลื่อนเศรษฐกิจของประเทศไทย ไม่เช่นนั้นเราจะแข่งขันกับตลาดโลกไม่ได้ ’

ปรีดา ยังยกตัวอย่างเพิ่มเติมเรื่อง ‘ ในอดีต สังคมไทย เคย มีอคติต่อคนที่อาศัยอยู่ในชุมชนแออัด (สลัม) อย่างรุนแรง ’ ในยุคหนึ่งถึงกับเรียกพื้นที่เหล่านี้ว่าเป็นแหล่งวิกฤติบ้าง แหล่งเสื่อมโทรมบ้าง แหล่งรวมบุคคลและสิ่งของผิดกฎหมายบ้าง ซึ่งหลายครั้งก็นำไปสู่การใช้ความรุนแรงอย่างการไล่รื้อหรือเผาไล่ที่ กระทั่ง ‘ มุมมองของสังคมได้เปลี่ยนไป ในทางที่ดีขึ้น จากงานศึกษาทางวิชาการที่ชี้ให้เห็นว่า คนในชุมชนแออัดมีบทบาทสำคัญใน ฐานะแรงงานผู้ ขับเคลื่อนเศรษฐกิจของเมือง ’ ทั้งในภาคการผลิตและภาคบริการ

การเปลี่ยนมุมมองของสังคมไทยต่อผู้อาศัยในชุมชนแออัดจึงถือเป็นบทเรียนได้เช่นกัน ว่าต้องมีทั้งงานวิชาการและงานสื่อสารทำความเข้าใจกับสังคมว่าด้วยเรื่องกลุ่มชาติพันธุ์และแรงงานข้ามชาติ ซึ่งในแง่สิทธิมนุษยชนต้องเข้าใจก่อนว่า ‘ คนทุกคนเป็นมนุษย์เท่าเทียมกัน ’ ดังนั้น ‘ การนำเสนอข้อมูลข่าวสารต่าง ๆ ต้องระมัดระวังการใช้ถ้อยคำดูหมิ่นเหยียดหยามหรือสร้างความเกลียดชังกับกลุ่มชายขอบ ’ หากสื่อ หรือนักสื่อสารเข้าใจเรื่องนี้การสื่อสารที่ออกไปก็จะไม่ย้อนกลับมาทำร้ายสังคม !!!

-/-/-/-/-/-/-/-/-/-/-

อ้างอิง

https://www.thairath.co.th/news/crime/2919120 (“เฮียตี๋ไทยไม่ทน” งานเข้า หนุ่มกะเหรี่ยง แจ้งจับกักขัง ทำร้ายร่างกาย พ.ร.บ.คอมพิวเตอร์ : ไทยรัฐ 10 มี.ค. 2569)

https://www.thairath.co.th/news/local/2919099 (ผู้ใหญ่บ้าน เปิดข้อมูล “น้องเดช” หนุ่มกะเหรี่ยงถูก “เฮียตี๋” สั่งสอน พบถือสัญชาติไทย : ไทยรัฐ 10 มี.ค. 2569)

https://web.facebook.com/share/p/1C5ua1CovX/ (‘เต้ อาชีวะ-เฮียตี๋’ ยกมือไหว้ขอโทษสังคม แฉแหลก หนุ่มชาติพันธุ์สุดกร่าง ยืนยันมีพยานหลักฐาน : โหนกระแส 11 มี.ค. 2569)

https://www.silpa-mag.com/history/article_45371 (“กะเหรี่ยง” เป็นใคร? มาจากไหน? มีความสัมพันธ์ กับไทยอย่างไร? : ศิลปวัฒนธรรม 30 ธ.ค. 2564)

https://www.geocities.ws/klity_creek/kareninthai1.htm (“กะเหรี่ยง” ความสัมพันธ์อันยาวนานกับไทย : สุรพงษ์ กองจันทึก , ศูนย์ศึกษากะเหรี่ยงและพัฒนา)

https://ethnicity.sac.or.th/database-ethnic/187 (ปกาเกอะญอ : ศูนย์มานุษยวิทยาสิรินธร)

https://ethnicity.sac.or.th/database-ethnic (กลุ่มชาติพันธุ์ในประเทศไทย : ศูนย์มานุษยวิทยาสิรินธร)

https://www.naewna.com/likesara/745665 (สัมผัส’วิถีกะเหรี่ยงทุ่งใหญ่นเรศวร’บ้านสะเนพ่อง ‘ครู-นักเรียนช่วยกันทำนา’ : แนวหน้า 24 ก.ค. 2566)

http://www.kkdopa.go.th/p7/1007–13-.html (ความหมายของเลขประจำตัวประชาชน 13 หลัก :ที่ทำการปกครองจังหวัดขอนแก่น)

https://www.bora.dopa.go.th/wp-content/uploads/2025/01/การจัดทำทะเบียนและบัตรคนซึ่งไม่มีสัญชาติ.pdf (การจัดทำทะเบียนและบัตรประจำตัวบุคคลผู้ไม่มีสัญชาติไทย : สำนักบริหารการทะเบียน กรมการปกครอง กระทรวงมหาดไทย)

https://www.isranews.org/content-page/item/57989-news012.html (คนเกิดปี27พ้นทุกข์!ปค.สั่งแก้ปัญหาเลขบัตรทั้งระบบแล้ว-รับพลาดช่วงเปลี่ยนเขียนมือสู่คอมฯ : สำนักข่าวอิศรา 14 ก.ค. 2560)

https://www.tvpoolonline.com/content/2496053 (“ตี๋กระทะร้อน” ยกมือไหว้ขอโทษคนเมืองกาญจน์ ปมบุกตX “หนุ่มชาติพันธุ์” เข้าใจผิดคิดว่าเป็นต่างด้าว : TVpoolonline 11 มี.ค. 2569)

https://www.youtube.com/watch?v=60keb0mT1DM (LIVE โหนกระแส เสียงแตก! “ตี๋กระทะร้อน” สวมบทโหด บุกยำหนุ่มกะเหรี่ยงเลือดสาด : โหนกระแส 11 มี.ค. 2569 นาทีที่ 31.50 – 32.20)

https://book.culture.go.th/newbook/book/other/nation.pdf (ชาติพันธุ์และมายาคติ : สํานักงานคณะกรรมการวัฒนธรรมแห่งชาติ กระทรวงวัฒนธรรม , 2546 – หน้า 103)

https://www.chumchonthai.or.th/sites/default/files/ebooks/22_chao-la_crisis/22_chao-la_crisis.pdf (วิกฤติ วิถีชาวเล , ปรีดา คงแป้น และคณะ , มูลนิธิชุมชนไท 2555)