เมื่อวันที่ 7 มกราคม 2568 มาร์ก ซักเคอร์เบิร์ก ซีอีโอบริษัทเมตา เจ้าของแพลตฟอร์มโซเชียลมีเดียยักษ์ใหญ่อย่างเฟซบุ๊ก อินสตาแกรม และเธรดส์ ได้ออกมาแถลงเกี่ยวกับการเปลี่ยนแปลงนโยบายของบริษัทกลับสู่ “รากเหง้า” ของแพลตฟอร์มในการเป็นพื้นที่เสรีภาพด้านการแสดงความคิดเห็น ด้วยการยกเลิกโครงการตรวจสอบข้อเท็จจริงโดยบุคคลที่สามและเตรียมหันมาใช้ฟีเจอร์ Community Notes คล้ายกับที่ใช้บน X แทน

ความเปลี่ยนแปลงครั้งใหญ่นี้มาจากการที่ซักเคอร์เบิร์กมองว่าผู้ตรวจสอบข้อเท็จจริงอิสระใช้อำนาจและอคติจนข้ามเส้นจากการตรวจสอบไปสู่การเซนเซอร์เนื้อหา แต่นักวิเคราะห์หลายรายมองว่านี่เป็นกลยุทธ์ทางการเมืองที่เมตาใช้เพื่อเอาใจรัฐบาลสหรัฐอเมริกาในยุคของประธานาธิบดีโดนัลด์ ทรัมป์

Community Notes คืออะไร?

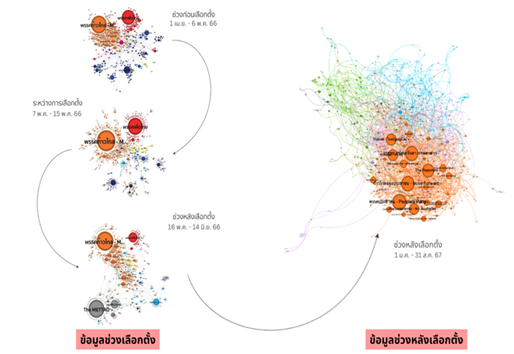

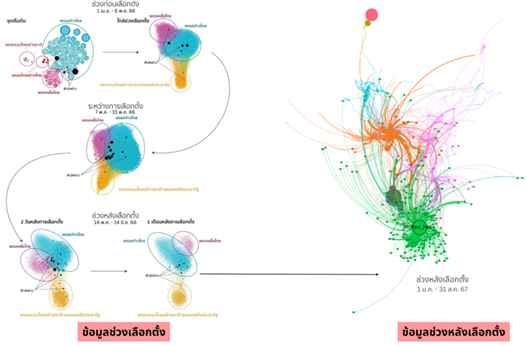

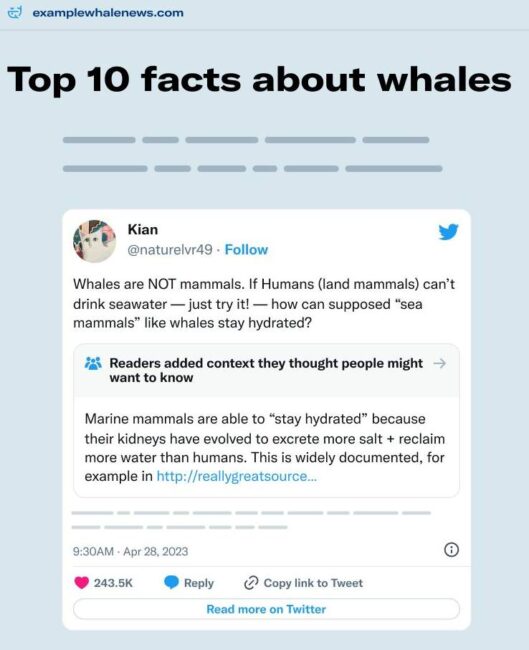

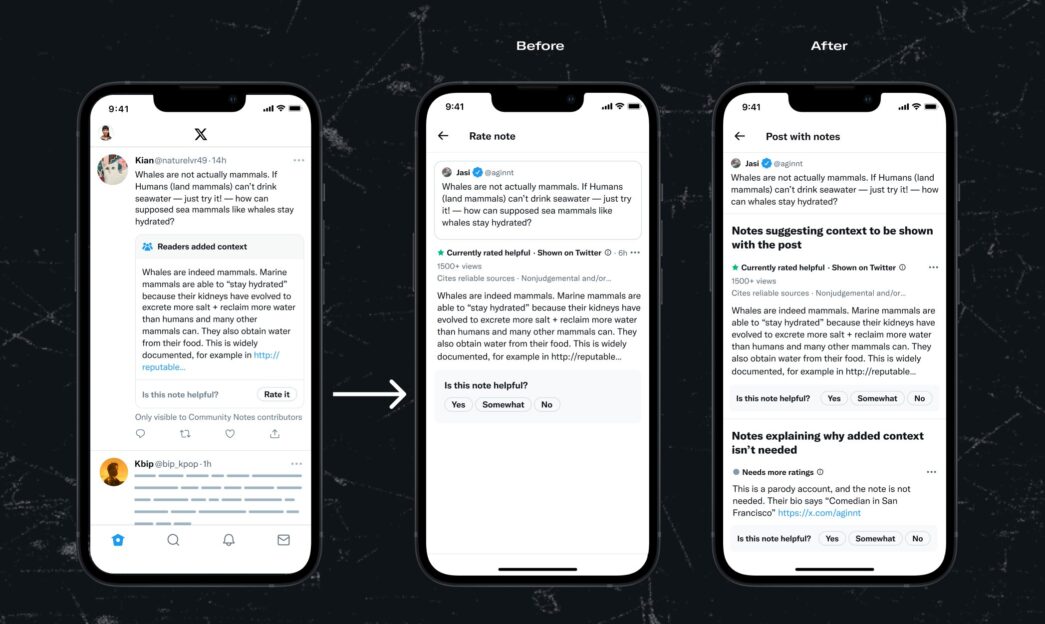

Community Notes หรือโน้ตชุมชน คือระบบที่เปิดโอกาสให้ผู้ใช้งานมีส่วนร่วมในการตรวจสอบความถูกต้องของเนื้อหาที่ถูกแชร์บนแพลตฟอร์ม โดยผู้ใช้งานที่มีคุณสมบัติเป็นผู้ให้ข้อมูล (contributor) จะสามารถเขียนโน้ตเพิ่มเติมเพื่ออธิบายหรือให้ข้อมูลที่ถูกต้องเกี่ยวกับโพสต์ที่อาจมีเนื้อหาเป็นเท็จ บิดเบือน หรือทำให้เข้าใจผิดได้ หากโน้ตได้รับการโหวตจากผู้ให้ข้อมูลอื่น ๆ ว่าเป็นข้อมูลที่เป็นประโยชน์เพียงพอ โน้ตเหล่านี้ก็จะปรากฏควบคู่ไปกับโพสต์ต้นฉบับเพื่อให้ผู้ใช้งานรายอื่น ๆ ได้พิจารณาข้อมูลทั้งสองด้านด้วยตัวเอง

(Credit @CommunityNotes via X)

จากประสบการณ์การใช้งานจริงของผู้เขียน ทั้งในฐานะผู้ใช้งานโซเชียลมีเดียและผู้ตรวจสอบข้อเท็จจริง ร่วมกับการเก็บข้อมูลจากงานวิจัยและความคิดเห็นของผู้เชี่ยวชาญ โคแฟคจะพาผู้อ่านไปทำความเข้าใจข้อดี-ข้อเสียของระบบ Community Notes ของ X ซึ่งน่าจะเป็นแม่แบบให้กับระบบใหม่ของเมตาเร็ว ๆ นี้

ข้อดีของ Community Notes

● ทุกคนมีส่วนร่วมในการตรวจสอบข้อมูล

ผู้ให้ข้อมูลต้องมีคุณสมบัติเบื้องต้นเป็นผู้ใช้งานที่สร้างบัญชี X มาไม่ต่ำกว่าหกเดือน มีเบอร์โทรศัพท์สำหรับยืนยันตัวตน และไม่เคยละเมิดกฎการใช้งาน X ซึ่งถือว่าเป็นคุณสมบัติพื้นฐานที่ทำให้ใคร ๆ ก็สามารถมีส่วนร่วมในการตรวจสอบข้อมูลได้ เท่ากับว่าผู้ใช้งานจะมีบทบาทในการสร้างสรรค์ชุมชนและกำหนดลักษณะของเนื้อหาบนแพลตฟอร์มด้วยตัวเอง

● ไม่จำกัดแค่การตรวจสอบข่าวปลอม

ผู้ให้ข้อมูลไม่ได้ถูกจำกัดเพียงแค่ว่าจะต้องเพิ่มโน้ตเกี่ยวกับข่าวปลอมหรือข้อมูลบิดเบือนเท่านั้น แต่ยังสามารถเพิ่มบริบทใด ๆ ก็ได้เกี่ยวกับโพสต์ ไม่ว่าจะเป็นการให้ข้อมูลว่าโพสต์ดังกล่าวอาจจะเป็นการแฝงโฆษณาหรือการโปรโมตสินค้าปลอมก็ย่อมทำได้ โน้ตชุมชนจึงทำหน้าที่เสมือนบริบทหรือเนื้อหาเพิ่มเติมเกี่ยวกับโพสต์ ทำให้ผู้ใช้งานมีโอกาสได้รับข้อมูลที่หลากหลายรอบด้านมากกว่าเดิม

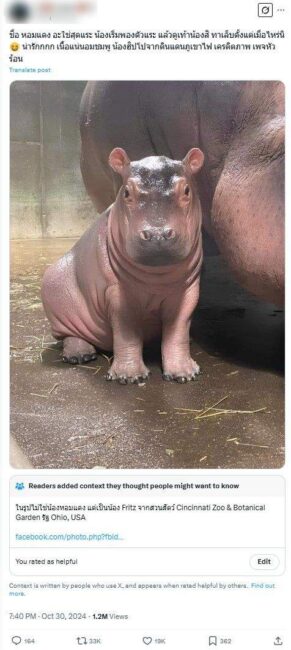

ตัวอย่างเช่น โพสต์ที่นำรูปของลูกฮิปโปของสวนสัตว์ซินซินนาติในสหรัฐอเมริกามาใช้และอ้างว่าเป็นลูกฮิปโปของสวนสมเด็จพระศรีนครินทร์ จังหวัดศรีสะเกษ โดยโน้ตชุมชนของผู้ให้ข้อมูลรายหนึ่งได้รับการโหวตและปรากฏขึ้นใต้โพสต์ดังกล่าวภายในเวลาไม่ถึง 24 ชั่วโมง และมียอดชมมากกว่า 18,000 ครั้ง ถือว่าเป็นความร่วมมือของผู้ใช้งานบนแพลตฟอร์มที่ช่วยกันตรวจสอบข้อมูลอย่างรวดเร็ว และไม่จำกัดเพียงแค่ประเด็นข่าวปลอมร้ายแรง อย่างเช่น ประเด็นการเมืองหรือภัยธรรมชาติเท่านั้น

● โปร่งใส-ตรวจสอบได้

โน้ตชุมชนถูกออกแบบมาให้เป็นระบบ crowdsourcing หรือระบบที่อาศัยความร่วมมือของกลุ่มคนที่หลากหลายโดยไม่มีการแทรกแซงจากตัวแพลตฟอร์มเอง ดังนั้น ข้อมูลของโน้ตที่ได้รับคะแนนโหวตให้ปรากฏใต้โพสต์ต่าง ๆ รวมถึงอัลกอริธึมการจัดลำดับโน้ตที่เป็นประโยชน์จึงสามารถเข้าถึงได้จากสาธารณะ

ข้อเสียของ Community Notes

● ขาดการตรวจสอบจากมืออาชีพ

เนื่องจากแนวคิดของโน้ตชุมชนคือการให้ผู้ใช้งานช่วยกันตรวจสอบข้อเท็จจริงของเนื้อหาในแพลตฟอร์มกันเอง เราจึงไม่อาจวางใจได้อย่างเต็มที่ว่าผู้ให้ข้อมูลมีความรู้ความเชี่ยวชาญในเรื่องที่ตัวเองเขียนโน้ตอย่างรอบด้านและปราศจากอคติ สิ่งสำคัญอย่างหนึ่งของการเขียนโน้ตชุมชนคือการอ้างอิงเว็บไซต์ที่มีความน่าเชื่อถือ ดังนั้น สุดท้ายแล้วผู้ให้ข้อมูลก็ยังจำเป็นต้องใช้แหล่งอ้างอิงจากบุคคลที่สาม เช่น รายงานข่าว หรือรายงานตรวจสอบข้อเท็จจริงจากเว็บที่เชื่อถือได้ ซึ่งถือเป็นเครื่องยืนยันหนึ่งว่าแพลตฟอร์มโซเชียลมีเดียต่าง ๆ ยังมีความจำเป็นต้องพึ่งพาพันธมิตรหรือองค์กรตรวจสอบข้อเท็จจริงเพื่อช่วยยับยั้งการแพร่กระจายของข่าวปลอม

● ใช้อัลกอริธึมตัดสิน

แม้ว่าจะมีโน้ตที่ได้รับการโหวตจากผู้ให้ข้อมูลรายอื่น ๆ ว่าเป็นข้อมูลที่เป็นประโยชน์ ก็ไม่ได้แปลว่าโน้ตเหล่านั้นจะปรากฏในโพสต์ที่เป็นปัญหา ที่ผ่านมามีโน้ตชุมชนที่ได้รับคะแนนโหวตว่าเป็นประโยชน์มากถึงร้อยละ 60 ที่ไม่ได้รับการเผยแพร่ เนื่องจากอัลกอริธึมของ X จะทำหน้าที่เป็นผู้ตัดสินว่าจะให้ระบบแสดงโน้ตดังกล่าวใต้โพสต์หรือไม่ ซึ่งนั่นหมายความว่าข้อมูลที่เป็นประโยชน์อาจไม่ได้ถูกเผยแพร่หรือไม่มีใครเห็นเลยหากอัลกอริธึมมองว่าคะแนนโหวตนั้นยังไม่ได้มาจากกลุ่มคนที่หลากหลายเพียงพอ

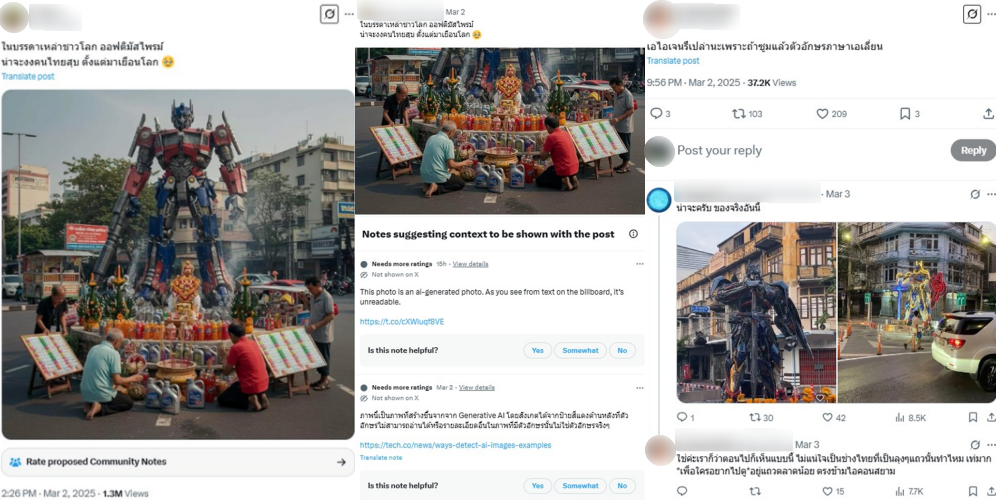

ภาพข้างบนเป็นตัวอย่างของโพสต์ที่อาจทำให้เข้าใจผิดว่าเป็นภาพรูปปั้นเทพออปติมัสไพรม์ของจริงในไทย ซึ่งมีผู้ให้ข้อมูลบางส่วนเขียนโน้ตชุมชนไว้แล้วว่านี่เป็นรูปที่สร้างจากเอไอ แต่โน้ตเหล่านั้นกลับไม่ปรากฏใต้โพสต์ดังกล่าวเพราะอัลกอริธึมมองว่ายังไม่ได้รับการโหวตจากกลุ่มผู้ใช้งานที่หลากหลายพอ การโพสต์เนื้อหาที่ถูกต้องไว้ใต้โพสต์นั้น ๆ จึงสามารถถูกมองเห็นและแชร์ไปยังผู้ใช้งานรายอื่น ๆ ได้อย่างรวดเร็วและมีประสิทธิภาพมากกว่าการใช้โน้ตชุมชน

เราคงไม่สามารถปฏิเสธได้ว่ามนุษย์ทุกคนย่อมมีอคติหรือความเชื่อส่วนตัวของตัวเอง และโซเชียลมีเดียก็เป็นหนึ่งในพื้นที่ที่ทุกคนสามารถแสดงความคิดเห็นของตัวเองได้ ดังนั้น ความพยายามของแพลตฟอร์มที่จะเป็นพื้นที่ของอิสรภาพในการแสดงออก ก็อาจจะไม่สามารถส่งเสริมให้แพลตฟอร์มนั้น ๆ เป็นพื้นที่ของข้อเท็จจริงได้ในเวลาเดียวกันหากปราศจากการควบคุมดูแลอย่างเหมาะสม

อย่างไรก็ตาม เมตายังไม่ได้ระบุเกี่ยวกับกรอบเวลาหรือระบบ Community Notes อย่างชัดเจน โดยกล่าวเบื้องต้นเพียงว่ามีแผนเริ่มใช้งานระบบดังกล่าวในสหรัฐอเมริกาภายในอีกไม่กี่เดือนข้างหน้า และจะขยายการใช้งานไปยังประเทศอื่น ๆ ในอนาคต

เรื่องอื่น ๆ ที่น่าสนใจ

- รายงานพิเศษ: แนวทางการสร้างสมดุลระหว่างเสรีภาพในการพูดและมาตรฐานความน่าเชื่อถือและความปลอดภัยในโลกออนไลน์ด้วยการกลั่นกรองเนื้อหาที่มีประสิทธิภาพ

- ‘ข่าวลวง-ข้อมูลบิดเบือน’ภัยคุกคามโลก ยุค ‘AI’ยิ่งเนียนแยกยาก ‘รู้เท่าทัน’ยิ่งจำเป็น ‘ตรวจสอบ’หน้าที่ทุกคน

- ‘บัญชีล้อเลียน’คล้ายคนดัง! ‘อีลอน มัสก์’เปิดให้เล่นสนุกบน‘X’ ผู้ใช้งานพึงสังเกต-โพสต์เกินขอบเขตระวังผิดกฎหมาย