“Cofact Live Talk” โดยภาคีโคแฟค (ประเทศไทย) ดำเนินรายการโดย สุภิญญา กลางณรงค์ ผู้ร่วมก่อตั้งภาคีโคแฟค (ประเทศไทย) รับชมผ่านเพจเฟซบุ๊ก “Cofact โคแฟค” ได้รับเกียรติจาก วุฒิชัย พุ่มสงวน อัยการจังหวัดประจำสำนักงานอัยการสูงสุด ศูนย์อัยการคุ้มครองสิทธิเด็ก เยาวชนและสถาบันครอบครัว เป็นวิทยากรในหัวข้อ “ทบทวนกฎหมายว่าด้วยการคุ้มครองเด็กและเยาวชนในสื่อมวลชน สื่อสังคมออนไลน์ และปัญญาประดิษฐ์แบบรู้สร้าง”

อัยการวุฒิชัย เล่าถึงภารกิจของศูนย์อัยการคุ้มครองสิทธิเด็ก เยาวชนและสถาบันครอบครัว ซึ่งรับผิดชอบกฎหมายเด็ก มีการประสานงานกับพนักงานสอบสวนและนักสังคมสงเคราะห์ ทำให้รู้ว่าปัญหาความรุนแรงที่เกี่ยวกับเด็กมีอยู่มาก แต่เพิ่มขึ้นอย่างมีนัยสำคัญในช่วงสถานการณ์โรคระบาดโควิด-19 จากการที่เด็กสามารถเข้าถึงอินเตอร์เน็ตได้อย่างไม่จำกัดผ่านอุปกรณ์ต่างๆ ไม่ว่าโทรศัพท์มือถือหรือคอมพิวเตอร์ ผ่านการสนับสนุนของพ่อแม่ผู้ปกครองที่ติดตั้งอินเตอร์เน็ตไร้สายและความเร็วสูง

ขณะที่คดีที่เข้ามา มีทั้งเด็กและเยาวชนเป็นผู้ก่อเรื่องและผู้ถูกกระทำ จากเดิมที่เป็นแบบเจอหน้าตา แต่เมื่อมาอยู่ในลักษณะออนไลน์ ก็ต้องยอมรับความจริงว่าพ่อแม่ผู้ปกครองไม่ค่อยจะเข้าไปสอดส่องดูแล้วให้บุตรหลานใช้อินเตอร์เน็ตอย่างปลอดภัย โดยหากดูข้อมูลตั้งแต่ปี 2562 เป็นต้นมา จะพบสถิติเพิ่มขึ้น 2-3 เท่า ซึ่งเด็กตามกฎหมายคืออายุต่ำกว่า 18 ปี พบการตกเป็นผู้เสียหายจำนวนมาก ตั้งแต่เรื่องใหญ่ๆ อย่างการล่อลวงทางเพศหรือหลอกลวงให้ซื้อสินค้า ไปจนถึงเรื่องเล็กๆ น้อยๆ อย่างการหลอกให้โอนแต้มในเกม

“ที่เจอมากับตัวคือ เด็กดูยูทูบ แล้วเลียนแบบอินฟลูเอนเซอร์ ทุกคนเตือนหมดว่าอย่าไปทำ แต่เด็กไม่มีความยับยั้งชั่งใจ ทำให้เกิดเรื่องขึ้น”

หนึ่งในคำถามที่น่าสนใจคือ “การที่ดาราหรือคนดังในสังคมนำเด็ก (ซึ่งโดยมากก็คือลูกของตนเอง) มาทำเนื้อหาต่างๆ เผยแพร่ในสื่อสังคมออนไลน์ สามารถทำได้หรือไม่?” ประเด็นนี้หากมองในแง่กฎหมาย จะมีกฎหมายหลายฉบับ เช่น “พ.ร.บ.คุ้มครองเด็ก พ.ศ.2546” ซึ่งหากไปดูมาตรา 27 ที่ระบุว่า “ห้ามมิให้ผู้ใดโฆษณาหรือเผยแพร่ทางสื่อมวลชนหรือสื่อสารสนเทศประเภทใด ซึ่งข้อมูลเกี่ยวกับตัวเด็กหรือผู้ปกครอง โดยเจตนาที่จะทำให้เกิดความเสียหายแก่จิตใจ ชื่อเสียง เกียรติคุณ หรือสิทธิประโยชน์อื่นใดของเด็ก หรือเพื่อแสวงหาประโยชน์สำหรับตนเองหรือผู้อื่นโดยมิชอบ” ดังตัวอย่าง เมื่อเจอเด็กที่ประพฤติตนไม่ถูกต้อง ไม่เหมาะสม สิ่งที่ถูกต้องที่ผู้ใหญ่ต้องทำ คือแจ้งเจ้าหน้าที่ไม่ใช่ไลฟ์สด

อัยการวุฒิชัย ขยายความเรื่องนี้จากความรู้ที่ได้รับจากการทำงานกับนักจิตวิทยา ว่า “สมองมนุษย์จะเติบโตอย่างสมบูรณ์จริงๆ ที่อายุ 25 ปี” ดังนั้น“อายุต่ำกว่า 18 ปี บอกได้เลยว่าทำตามอารมณ์”ไม่ได้ตัดสินใจด้วยเหตุผล ประกอบกับสื่อสังคมออนไลน์ที่บางครั้งเรามองว่าเป็นเรื่องสนุกหากนำเด็กมาเต้น มาเล่น แต่ก็เป็นมุมมองส่วนตัวของผู้ใหญ่ที่โพสต์ เพราะเมื่อเผยแพร่บนโลกออนไลน์แล้วย่อมมีมุมมองที่หลากหลาย ในขณะที่หลายคนอาจมองเป็นเรื่องตลกหรือน่ารัก แต่ก็มีคนจำพวกมีรสนิยมใคร่เด็ก (Pedophile) หรือคนที่มองในมุมอื่น ก็ทำให้เกิดผลกระทบได้

“ถามว่าคนโพสต์ผิดกฎหมายไหม? ก็คงต้องดูในลักษณะที่เป็นภววิสัย คือเชิงสังคมมองว่าการกระทำนั้นเป็นความผิดไหม? เช่น คุณแม่ไลฟ์สดอาบน้ำลูก ซึ่งคุณแม่ก็เอ็นดูเด็ก แต่เมื่อไรที่มันขึ้นสู่โลกโซเชียลมีเดีย จะไม่มีวันลบเลือน มันอยู่ไปได้หลายสิบปีจนเราตาย แล้วลองนึกถึงเด็กคนนี้โตมารู้เรื่อง ประมาณ 10-12 ปี แล้วเกิดมีเพื่อนย้อนไปดูคลิปวีดีโอของแม่ในเฟซบุ๊กหรืออะไรต่างๆ แล้วก็เห็นรูปเรากำลังแก้ผ้าอาบน้ำอยู่ แล้วเอามาล้อเลียน อย่างนี้ก็จะเกิดปัญหา เกิดผลกระทบ แต่หากแก้ผ้าอาบน้ำเป็นเด็กทารก ก็อาจไม่ได้มีลักษณะเชิงเสียหาย แต่เด็กได้รับผลกระทบในด้านจิตใจแล้ว

มีเรื่องที่อยากฝากถึงอินฟลูเอนเซอร์ทั้งหลาย ว่าการล่วงละเมิดเด็กในลักษณะไปทำข่าวหรือไปทำข้อมูลซ้ำในทางที่ไม่เหมาะสม เป็นคดีอาญาแผ่นดิน หมายความว่าใครแจ้งความก็ได้ ผมอาจจะให้เป็นแนวคิดว่า เด็กไม่ใช่สมบัติของพ่อแม่ แต่เด็กเป็นสมบัติของคนทั้งชาติ เพราะถ้าไม่คิดแบบนี้ก็คงไม่อนุญาตให้ทุกคนแจ้งความพ่อแม่ได้ ดังนั้นเวลาที่เราไปเจอกรณีที่พ่อแม่กระทำ ถึงแม้พ่อแม่จะไม่ได้มีเจตนาอย่างนั้น แต่ลักษณะการกระทำ วิญญูชนคนปกติเขาย่อมเข้าใจได้ว่า การแก้ผ้าลูกอาบน้ำมันเป็นสิ่งที่ไม่เหมาะสม ลูกอายุขวบสองขวบแล้วไม่ควรทำ อันนี้สามารถแจ้งความดำเนินคดีกับพ่อแม่ได้”

อย่างไรก็ตาม แม้เรื่องนี้อาจเป็นความผิดได้และมีการแจ้งความดำเนินคดี ศาลก็อาจใช้ดุลพินิจลงโทษสถานเบาหรือหนัก แต่ก็ต้องย้ำว่า “ไม่สามารถอ้างความยินยอมของเด็กได้แม้จะเป็นลูกตนเอง” เพราะ พ.ร.บ. คุ้มคองเด็ก ให้หลักไว้ว่า 1.เด็กมีอายุต่ำกว่า 18 ปี ถือว่าอายุยังน้อย 2.อยู่กับพ่อแม่หรือผู้ใหญ่ที่มีอำนาจโน้มน้าวใจ ส่งผลให้ในทางปฏิบัติอาจจะไม่มีใครกล้าแจ้งความก็ได้ ดังนั้นหากคิดตามหลักเด็กคือสมบัติของชาติไม่ใช่แค่สมบัติของพ่อแม่ องค์กรที่ทำงานด้านสิทธิเด็กก็อาจแจ้งความแทนได้

อัยการวุฒิชัย เปิดเผยว่า ที่ผ่านมามีเจ้าหน้าที่ตำรวจส่งหลักฐานคลิปวีดีโอรายการต่างๆ มาปรึกษาว่าแบบนี้ผิดหรือไม่? ซึ่งหลายก็กรณีก็เข้าข่ายกระทำผิด เพียงแต่สังคมไทยเราอาจเคยชินกับการให้อภัย ก็อาจไม่ได้ดำเนินคดี อาศัยการตักเตือนไปก่อนโดยผู้โพสต์ก็รับปากว่าจะไม่ทำอีก แต่ในเวลาต่อมาก็ยังทำแบบเดียวกันซ้ำ ซึ่งหลายเรื่องสังคมก็ต้องช่วยกันดู บางครั้งอาจมองว่าเป็นเรื่องเล็กน้อยที่พ่อแม่ทำกับลูก แต่จริงๆ ไม่ใช่ หากไปเจอคนที่รู้กฎหมายแล้วไปแจ้งความก็จะเป็นคดีขึ้นมา

เมื่อถามเพิ่มเติมว่า “การที่พ่อแม่ขายของออนไลน์แล้วนำลูกมาร่วมในไลฟ์สดด้วยผิดหรือไม่?” ประเด็นนี้ต้องบอกว่าเป็น “เส้นบางๆ” เพราะมุมหนึ่งมองได้ว่าลูกช่วยพ่อแม่หาเงิน ซึ่งหากเป็นลักษณะที่ไม่ได้รับผลกระทบ เช่น ไม่ได้ขายเครื่องดื่มแอลกอฮอล์ ชุดชั้นใน ดังตัวอย่างเคยมีกรณีเด็ก8 ขวบไปเต้นฮูลาฮุปหาเงินเลี้ยงดูยาย แม้จะมีเจตนาดีแต่การที่เด็กใส่ชุดว่ายน้ำไปเต้นก็ต้องพิจารณาได้ว่าไม่เหมาะสม แต่หากเป็นกรณีไลฟ์สดให้ลูกช่วยขายขนมทั่วๆ ไป แบบนี้ในความเห็นส่วนตัว มองว่าไม่ทำให้เด็กได้รับผลกระทบ แต่คนที่จะบอกได้ดีที่สุดคือนักจิตวิทยาเด็ก

โดยคนที่ทำงานด้านนี้จะมีมาตรฐานว่าเด็กแต่ละวัยจะมีพัฒนาการด้านจิตใจอย่างไรบ้าง และหากต่ำกว่ามาตรฐานก็อาจเป็นความผิดได้ ซึ่งหากไปดู “กฎกระทรวงกำหนดมาตรฐานขั้นต่ำในการอุปการะเลี้ยงดู อบรมสั่งสอน และพัฒนาเด็กที่อยู่ในความปกครองดูแล พ.ศ. 2549” มีการกล่าวถึง “พัฒนาการที่สมวัย” ก็มีประเด็นต้องระวัง เช่น พ่อแม่ไลฟ์สดขายของหลังเวลา 22.00 น. ลากยาวไปถึง 02.00-03.00 น. แล้วนำลูกมาช่วยขายของด้วย ทั้งที่เวลานั้นควรเป็นเวลาพักผ่อนของเด็ก หากจิตแพทย์ประเมินว่าส่งผลกระทบต่อสมองเด็ก ก็อาจเข้าข่ายผิดกฎหมายได้

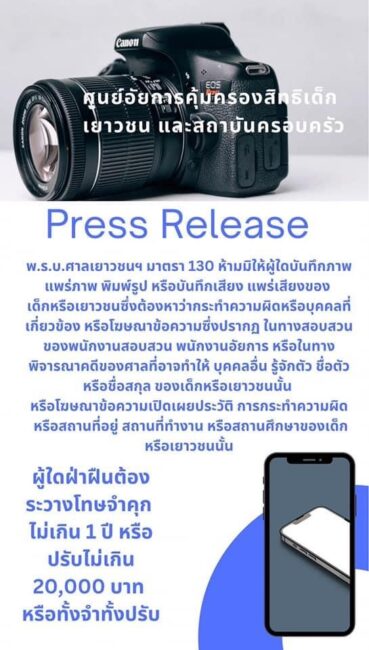

อัยการวุฒิชัย อธิบายเพิ่มเติมในส่วนของ “สื่อลามกอนาจาร” ว่าหมายถึงการเห็นหัวนมหรืออวัยวะเพศ และมีลักษณะส่อไปในทางเพศ ซึ่ง “ประมวลกฎหมายอาญา มาตรา 287/1” ระบุว่า (วรรคหนึ่ง) ผู้ใดครอบครองสื่อลามกอนาจารเด็กเพื่อแสวงหาประโยชน์ในทางเพศสำหรับตนเองหรือผู้อื่น ต้องระวางโทษจำคุกไม่เกิน 5 ปี หรือปรับไม่เกิน 100,000 บาท หรือทั้งจำทั้งปรับ (วรรคสอง) ถ้าผู้กระทำความผิดดังกล่าวส่งต่อซึ่งสื่อลามกอนาจารเด็กแก่ผู้อื่น ต้องระวางโทษจำคุกไม่เกิน 7 ปี หรือปรับไม่เกิน 140,000 บาท หรือทั้งจำทั้งปรับ

หรือสรุปได้ว่า “มีสื่อลามกเด็กในครอบครอง อาจถูกโทษจำคุกได้สูงสุด 5 ปี แต่หากส่งต่อให้บุคคลอื่น โทษจะหนักขึ้นเป็นจำคุกได้สูงสุดถึง 7 ปี”นอกจากนั้น หากนำไปเผยแพร่บนอินเตอร์เน็ต ยังจะมีความผิดตาม “พ.ร.บ.ว่าด้วยการกระทำความผิดเกี่ยวกับคอมพิวเตอร์ พ.ศ.2550” ในส่วนของ “มาตรา 14 (4)” ที่ระบุว่า ผู้ใดกระทำความผิดที่ระบุไว้ดังต่อไปนี้ (นำเข้าสู่ระบบคอมพิวเตอร์ซึ่งข้อมูลคอมพิวเตอร์ใดๆ ที่มีลักษณะอันลามก และข้อมูลคอมพิวเตอร์นั้นประชาชนทั่วไปอาจเข้าถึงได้) ต้องระวางโทษจำคุกไม่เกินห้าปี หรือปรับไม่เกินหนึ่งแสนบาท หรือทั้งจำทั้งปรับ เพิ่มอีกข้อหาหนึ่ง ทั้งนี้ คำว่า “ประชาชนทั่วไปอาจเข้าถึงได้” รวมถึงช่องทางที่ต้องจ่ายเงินเพื่อเข้าถึงด้วย

กรณี “การใช้เครื่องมือปัญญาประดิษฐ์ (AI) สร้างสื่อลามกอนาจาร จะมีความผิดหรือไม่?”อัยการวุฒิชัย กล่าวว่า บางครั้งการสร้างจะใช้คำสั่งผนวกระหว่างรูปภาพหนึ่งกับอีกรูปภาพที่มีความเซ็กซี่ (Sexy) แต่คำว่าเซ็กซี่ในระบบคอมพิวเตอร์บางทีก็ไม่เหมือนกัน เช่น ใส่ชุดว่ายน้ำ ใส่ชุดนักเรียน ไปจนถึงใส่ชุดชั้นในแบบจี-สตริง หรือชุดชั้นในแบบบางๆ ก็ต้องบอกว่า “หาก AI สร้างผลงานเองก็ไม่มีความผิด แต่หากมีคนกำหนดคำสั่งคนคนนั้นก็อาจมีความผิดได้” อาทิ นำภาพบุคคลหนึ่งไปสวมทับกับเรือนร่างของอีกบุคคลหนึ่งที่มีลักษณะเซ็กซี่

“ต้องเปรียบเทียบก่อน AI ก็เป็นแค่เครื่องมือชิ้นหนึ่ง เหมือนเราเอากระดาษสีไปแปะบนหน้าชิ้นนั้นชิ้นนี้ แต่ตอนที่ไปเผยแพร่ คนที่เผยแพร่ก็มีความผิดด้วย แล้วถึงบางทีเราทำเล่นๆ อยู่ที่บ้านแล้วเกิดมันหลุดรั่วออกมา มันก็มีโอกาส บางทีเราลบแล้วมันลบไม่หมด ฉะนั้นตัว AI อาจจะไม่มีความผิด แต่คนที่ออกคำสั่งกับคนที่เอาไปเผยแพร่อันนี้มีความผิด และโทษหนักด้วย”

อัยการวุฒิชัย กล่าวเพิ่มเติมในประเด็นการสร้างสื่อลามกด้วย AI ว่า กฎหมายที่น่าจะนำมาประยุกต์ใช้ได้ คือ “พ.ร.บ.ว่าด้วยการกระทำความผิดเกี่ยวกับคอมพิวเตอร์ พ.ศ.2550 มาตรา 16” ที่ระบุว่า ผู้ใดนำเข้าสู่ระบบคอมพิวเตอร์ที่ประชาชนทั่วไปอาจเข้าถึงได้ซึ่งข้อมูลคอมพิวเตอร์ที่ปรากฏเป็นภาพของผู้อื่น และภาพนั้นเป็นภาพที่เกิดจากการสร้างขึ้น ตัดต่อ เติม หรือดัดแปลงด้วยวิธีการทางอิเล็กทรอนิกส์หรือวิธีการอื่นใด โดยประการที่น่าจะทำให้ผู้อื่นนั้นเสียชื่อเสียง ถูกดูหมิ่นถูกเกลียดชัง หรือได้รับความอับอาย ต้องระวางโทษจำคุกไม่เกินสามปีและปรับไม่เกินสองแสนบาท

อย่างไรก็ตาม “AI เป็นเครื่องมือที่ขยายศักยภาพในการก่อเรื่องราว” ซึ่งก็มีทั้งด้านที่เป็นคุณและเป็นโทษ และตนก็เคารพเสรีภาพในการใช้สื่อหรือใช้คอมพิวเตอร์ แต่สิ่งที่ต้องมีคือ “ระบบยืนยันตัวตนว่ามีอายุถึงวัยอันควร” โดยอาจใช้ข้อมูลชีวภาพ เช่น บัตรประชาชนประกอบกับลายนิ้วมือ เพื่อให้สอดคล้องกับเกณฑ์อายุขั้นต่ำไม่ว่าจะเป็น 18 ปี 20 ปี หรือ 25 ปี ตามที่ผู้พัฒนาประโปรแกรมอนุญาตให้ใช้ จึงต้องทำให้เด็กและเยาวชนได้เติบโตอย่างแท้จริงตรงตามอายุที่ผู้พัฒนาโปรแกรมกำหนดไว้ ไม่ใช่ใส่ข้อมูลได้เองโดยที่ไม่ตรงกับข้อเท็จจริง

หมายเหตุ : ยังมีอีกหลายประเด็นที่น่าสนใจ ซึ่งสามารถรับชมคลิปเต็มย้อนหลังได้ที่ https://www.facebook.com/CofactThailand/videos/2029724844090039/